Imparten a estudiantes el taller online “Inteligencia Artificial y Ética Académica: Usa la Tecnología con Integridad”

Universidad Galileo reafirma su compromiso con la integridad académica mediante el taller «Inteligencia Artificial y Ética Académica: Usa la Tecnología con Integridad«, guiando a los estudiantes en el uso responsable y ético de la tecnología en sus procesos de aprendizaje.

La irrupción de la inteligencia artificial (IA) generativa en el ámbito académico ha revolucionado la forma en que estudiantes y docentes abordan el aprendizaje y la investigación. Sin embargo, su uso también plantea desafíos éticos que requieren ser analizados con profundidad.

Otro artículo que puedes leer: IA generativa: Universidad Galileo participa en el IFE Conference 2025 del Tec de Monterrey

La ética académica, entendida como el conjunto de principios que guían las buenas prácticas en la investigación y el aprendizaje, es esencial para garantizar que la tecnología se utilice de manera responsable y transparente.

También te puede interesar leer: Exitoso cierre de la “Certificación en Innovación con Inteligencia Artificial Generativa” en Banco de Guatemala

En este contexto, Universidad Galileo ha demostrado su compromiso con la integridad académica mediante la organización del taller online «Inteligencia Artificial y Ética Académica: Usa la Tecnología con Integridad«.

Este taller, liderado por la MSc. Flor Sagastume, docente del Área de Educación Digital del GES en Universidad Galileo, y acompañado por la MSc. Mónica de la Roca, buscó sensibilizar a los estudiantes sobre el impacto de la IA en sus prácticas académicas y cómo pueden utilizar estas herramientas de manera ética y responsable.

Uso responsable de la IA

Uno de los objetivos destacados del taller «Inteligencia Artificial y Ética Académica: Usa la Tecnología con Integridad» fue analizar el impacto de la inteligencia artificial en la ética académica, identificando tanto sus beneficios como los riesgos en el entorno universitario.

También se evaluó el uso responsable de herramientas de IA en la investigación y el aprendizaje, diferenciando entre prácticas aceptables y deshonestas.

Así mismo, se aplicaron los principios de integridad académica para tomar decisiones informadas sobre el uso de IA en tareas y proyectos académicos.

La IA y su aplicación en la vida cotidiana

Según la Comisión Europea, la inteligencia artificial es «un campo de la informática que se enfoca en crear sistemas que puedan realizar tareas que normalmente requieren inteligencia humana, como aprendizaje, el razonamiento y la percepción».

«Estos sistemas pueden percibir su entorno, razonar sobre el conocimiento, procesar la información derivada de los datos y tomar decisiones para lograr un objetivo dado», añade el principal órgano ejecutivo de la Unión Europea.

La MSc. Flor Sagastume enfatizó que la IA está presente en múltiples sectores de la vida diaria, como en los teléfonos inteligentes, los carros autónomos, los sistemas de distribución de Amazon y en procesos administrativos relacionados con la salud y la contabilidad.

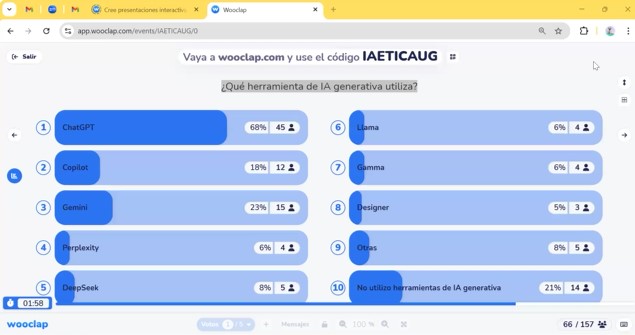

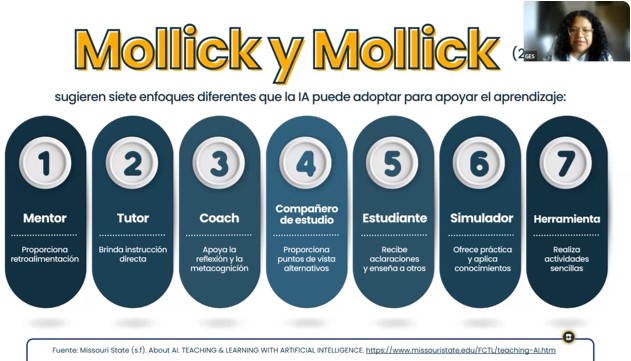

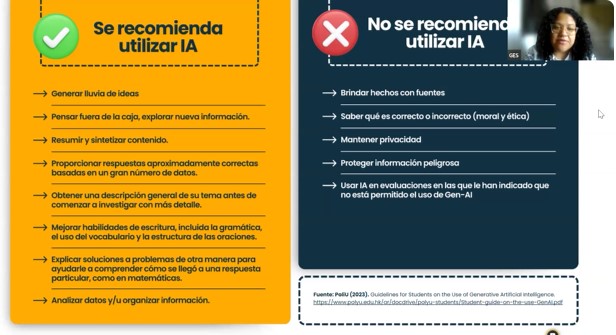

Durante el taller se destacaron las herramientas de inteligencia artificial generativa más comunes como ChatGPT, Copilot y Gemini. Además, se proporcionaron recomendaciones basadas en informes especializados sobre cómo utilizar estas herramientas de manera productiva, como para generar ideas, sintetizar información o mejorar habilidades de escritura.

Riesgos y buenas prácticas en el uso de la IA

En el taller «Inteligencia Artificial y Ética Académica: Usa la Tecnología con Integridad» se presentó que aunque la IA ofrece múltiples beneficios, también presenta riesgos significativos. Entre ellos, se encuentran:

- Exactitud: La IA puede generar información incompleta, inexacta o falsa, e incluso inventar citas.

- Sesgo: Puede reproducir prejuicios y utilizar lenguaje discriminatorio o no inclusivo.

- Calidad: El contenido generado puede carecer de originalidad o derivar en plagio.

- Privacidad: La información ingresada en sistemas de IA puede ser utilizada para entrenar sus algoritmos.

Por ello, en la Universidad Galileo se recomienda utilizar la IA generar ideas, mejorar lo que ya se ha trabajado, facilitar la comprensión de conceptos y apoyar la investigación. Sin embargo, se enfatizó que estas herramientas no deben ser utilizadas para buscar datos con fuentes sin verificación o en evaluaciones donde su uso está prohibido.

También se se enfatizó que los estudiantes deben verificar si los docentes ya tienen permitido el uso de IA en sus cursos para hacer una tarea en específico.

Durante el evento se subrayó los valores fundamentales que deben guiar el uso ético de la inteligencia artificial:

- Honestidad: Reconocer y transparentar el uso de la IA.

- Confianza: Analizar críticamente las respuestas antes de utilizarlas.

- Justicia: Seguir directrices claras sobre cuándo y cómo utilizar la IA.

- Respeto: Usar la IA para potenciar el aprendizaje, no para sustituirlo.

- Responsabilidad: Ser consciente de la responsabilidad en la producción del trabajo académico.

- Valentía: Estar dispuestos a aprender y enfrentar nuevos desafíos tecnológicos.

Actividades prácticas y recursos de apoyo

Una de las dinámicas del taller «Inteligencia Artificial y Ética Académica: Usa la Tecnología con Integridad» incluyó la presentación de escenarios donde los estudiantes debían identificar si el uso de la IA era ético o deshonesto. Esta actividad promovió la reflexión sobre la aplicación práctica de los principios de integridad académica.

Por último, se informó a los asistentes sobre los recursos que Universidad Galileo pone a disposición para fortalecer la integridad académica, como la página web de integridad académica, capacitaciones continuas y guías accesibles para estudiantes a través del Centro de Enseñanza y Aprendizaje.

Este taller reafirma el compromiso de Universidad Galileo de fomentar un entorno académico íntegro y consciente, donde la tecnología se utilice como una herramienta de apoyo y crecimiento, siempre guiada por valores éticos fundamentales.

Texto: GES Comunicación Digital